2 篇帖子被拆分到一个新主题:是否可以只启用一个 AI 角色?

RAILS_ENV=production bundle exec rake assets:precompile discourse 自托管版本因 scss 编译错误,无法与最新的 discourse-AI 插件协同工作。@use “lib/viewport” 应该是 discourse-ai.css 的第一行。你能检查一下吗?

您是针对Discourse的早期版本运行此命令,还是在主版本上运行?

在 Discourse 的稳定版本 (3.4.6) 上安装 Discourse AI 插件后,我发现 Discourse 显示 #bdef136(2025 年 2 月 4 日的提交)是最新提交,并且当前安装的插件是最新版本。

但是,当我因为 AWS Bedrock 集成所需的关键字段未显示而再次检查时,我发现它落后了至少 300 次提交,当我实际进入 discourse-ai 存储库并检查主分支时,差距很大。此症状也出现在我管理的其他 Discourse 实例中,我无法弄清楚问题所在。

我在现有实例上安装 discourse-ai 插件还不到一周,但实际安装的版本提交已经有 4-5 个月了,我想知道为什么它显示为最新,以及如何修复插件以替换为最新提交。

插件在稳定版发布后会被固定。这意味着您将不会自动获得较新的插件更新,这些更新可能依赖于尚未包含在稳定版中的 Discourse 核心的更改。

如果插件更新使用了仅存在于最新通过测试分支中的代码,它可能会在稳定版上中断,因为该代码根本不存在。

例如,AI 插件开始使用 js-diff 库,该库是在二月份稳定版发布后才添加到 Discourse 核心的。因此,AI 插件的最新版本将无法与该稳定版一起使用。

哦,我明白了!所以 app.yml 文件中的 git clone 命令比该文件中提到的增加了更多行为!现在说得通了。![]()

现在,当我激活 AI 插件并在插件中添加新的 LLM 时,除了能够选择 AWS Bedrock 之外,为什么当我选择 Bedrock 作为提供商时,AWS bedrock 访问密钥 ID 和 AWS bedrock 区域输入字段没有出现,这与本文档中提到的情况不同:Configuring Amazon Bedrock services

我正在使用 Discourse 版本 3.4.5,AI 插件版本是 0.0.1

和 bdef136。

我们不支持在稳定版 Discourse 上使用 Discourse AI,请使用我们的默认发布频道以获得最佳体验。

![]() 此插件现已作为 Bundling more popular plugins with Discourse core 的一部分,随 Discourse 核心一起提供。如果您是自托管用户并使用了此插件,则需要在下次升级前将其从您的

此插件现已作为 Bundling more popular plugins with Discourse core 的一部分,随 Discourse 核心一起提供。如果您是自托管用户并使用了此插件,则需要在下次升级前将其从您的 app.yml 中移除。

我正在尝试使用 Azure 设置此插件。我们通过使用 Azure 的自有网关连接到 OpenAI。我曾尝试使用手动 LLM 配置进行设置。

正在通过 DiscourseAi::Admin::AiLlmsController#test 处理,格式为 JSON

参数:{“ai_llm”=>{“max_prompt_tokens”=>“2000”, “api_key”=>“[FILTERED]”, “tokenizer”=>“DiscourseAi::Tokenizer::OpenAiTokenizer”, “url”=>“<OUR_URL>”, “display_name”=>“test-ai-gateway”, “name”=>“gpt-4_0613-pgo-amrs”, “provider”=>“azure”, “enabled_chat_bot”=>“true”, “vision_enabled”=>“false”}}

这似乎不起作用。有人能提供正确的设置方法吗?

我的问题:

在使用 AI 模型进行全文翻译时,我发现结果平平。我想切换到另一个 AI 模型来重新翻译内容。如何使用新模型重新翻译已翻译的帖子?

此外,是否有快速计算已翻译帖子数量的有效方法?

目前,您需要使用 Rails 或 PostgreSQL 控制台来删除现有的翻译。

我们计划添加一个状态页面,其中包含每种语言在翻译积压工作中的进度。

抱歉,我找不到要删除的特定表。您能告诉我表名以及翻译进度的路线图在哪里吗?

你好,关于 GPT 5 是否会有更新?

您好,没有任何官方公告表明 Discourse 团队说了 GPT-5 更新或其存在;但如果您真的想要,请等到它发布后再查看。

即将登陆:

关于 GPT-5 的说明,我一整天都在使用它,它很好,但它是一个推理模型,所以速度很慢。

可以随意调整推理强度,低强度下速度尚可,但比 4.1 慢得多。

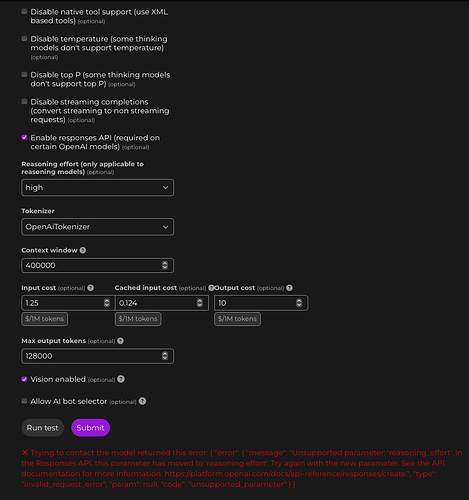

拉取了最新的更新,看起来 OpenAI 已经进行了一些 API 更改

尝试联系模型时返回了此错误:{ “error”: { “message”: “不支持的参数:“reasoning_effort”。在 Responses API 中,此参数已移至“reasoning.effort”。请尝试使用新参数重试。有关更多信息,请参阅 API 文档:https://platform.openai.com/docs/api-reference/responses/create。”, “type”: “invalid_request_error”, “param”: null, “code”: “unsupported_parameter” } }

我已将 URL 设置为 https://api.openai.com/v1/responses。

它在 completions API 下运行。我将跟进 fox 以获取 responses API。

FYI GPT-5 with Responses 速度极其缓慢,所有人都这么说。

几个小时前我推送了一个修复程序,试试看。

太棒了,老板!![]()

![]()