どうもありがとうございます

Deepseekは使用できますか?

はい、OpenAI互換のAPIを備えています

設定が見つかりません(あなたがスクリーンショットで見せたものも)管理画面>AI設定のどこにもありません。

これはペルソナ内で利用可能です。編集可能な(システムではない)特定のペルソナを選択し、プロンプトの下を確認してください。

4件の投稿が既存のトピックにマージされました: Will RAG Support PDF Files in the Future?

投稿が新しいトピックに分割されました:AIの応答を受信しているトピックに視覚的な手がかりを提供する

2件の投稿が新しいトピックに分割されました: 私のペルソナに知識を追加する方法

2つの投稿が新しいトピックに分割されました:AIプラグインに関する個人のプライバシーの懸念

Discourse Metaへようこそ!

これは#supportに投稿してください。

皆さん、こんにちは。vLLMをセルフホストしており、FernetでAPIトークンを生成していますが、トークンには「=」記号が含まれています。/var/discourse/shared/standalone/log/var-log/nginx/error.logを確認したところ、「=」記号が「%3D」に置き換えられているため、リクエストが承認されていないようです。

これはあり得ることでしょうか?解決策はありますか?

ご入力ありがとうございます。

私のケースは非常にシンプルです。すでにvLLMとopenWebUIのサービスがあり、LLMを公開しています。どちらも正常に機能しています。また、簡単なcURL呼び出しで、Discourseコンテナ内から両方にアクセスできることを確認できます。

vLLM:

curl -v ${LLM_URL} -H "Content-Type: application/json" -H "Authorization: Bearer ${LLM_TOKEN}" \

-d '{

"model": "'"${LLM_MODEL}"'",

"prompt": "'"${TEST_PROMPT}"'",

"max_tokens": 128,

"temperature": 0

}'

openWebUI:

curl -v ${LLM_URL} -H "Content-Type: application/json" -H "Authorization: Bearer ${LLM_TOKEN}" \

-d '{

"model": "'"${LLM_MODEL}"'",

"messages": [

{ "role": "user",

"content": "'"${TEST_PROMPT}"'"

}

]

}'

次に、セルフホスト型のDiscourseにdiscourse-aiプラグインをインストールし、「LLMs」-“>「手動設定」-”>Provider=vLLM経由でアクセスを設定しようとしました。どちらの場合もAPI KEYを提供する必要があります。残念ながら…どれもうまくいきません:

vLLM(Fernetトークン使用)は「error":“Unauthorized”」を返します

openWebUIは「{“detail”:“Not authenticated”}」を返します

Fernetトークンは「=」記号が「%3D」に変換されるため失敗しているのではないかと疑っていますが、「Not authenticated」についてはさらに困惑しています。トークンは単なる文字列だからです。

「discourse-ai」プラグインがvLLMの場合にどのようにトークン/API_KEYを送信するのかわかりませんが、「Bearer

Any help is welcome or experience in configuring vLLM with API_KEY

APIプロバイダーをOpenAIに設定してみてください。APIがBearerトークン形式で必要な場合です。

それは少なくともopenWebUIではうまくいきました!どうもありがとうございます!

2 件の投稿が新しいトピックに分割されました:Discord検索とディスカバリーをテストするための最適なモデルとプロンプト

フォーラムのAIの出力に関する問題があります。

私のフォーラムの言語は「アラビア語」なので、AIの出力言語をフォーラムの言語に合わせて設定する必要があります。アラビア語でトピックの概要やトピック全体を要求するのは適切ではありませんが、出力が「英語」で返ってきます。

プロンプトで、AIがアラビア語で応答するように指示してください。理論的には「同じ言語で応答する」でも機能するはずですが、少なくともOpenAIモデルを使用したフィンランド語のコンテキストでは、ほとんど機能しませんでした。

したがって、設定があり、それが使用されるAIエージェント/担当者のシステムプロンプトです。

英語以外の言語が検出された場合、この動作をデフォルトとして使用するのは理にかなっていますか?

スペイン語を使用してすべての人格を繰り返していますが、非常に多くの(良い)変更でそれらを最新の状態に保つのは困難です。

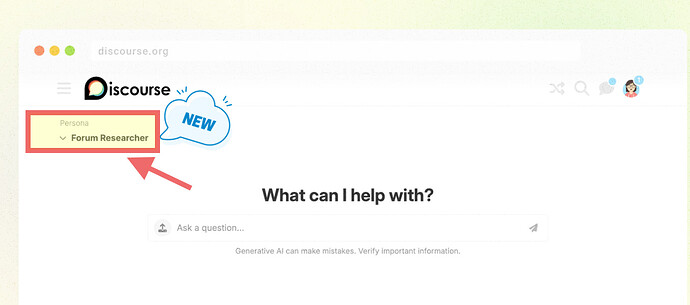

AIプラグインの「ペルソナ」タブで設定できます。