Muito obrigado

Podemos usar Deepseek?

Sim, ele tem uma API compatível com Open AI

Por favor, não consegui encontrar esta configuração (nem a que você mostrou na SUA captura de tela) em Administrador > Configurações de IA.

Isso está disponível em Personas, selecione uma persona específica editável (não do sistema) e veja abaixo o prompt.

4 posts foram mesclados em um tópico existente: O RAG suportará arquivos PDF no futuro?

Um post foi separado para um novo tópico: Fornecer sinal visual quando um tópico estiver recebendo uma resposta de IA

2 posts foram divididos para um novo tópico: Ways to add knowledge to my persona

2 posts foram separados para um novo tópico: Preocupações sobre privacidade pessoal com o plugin de IA

Bem-vindo ao Discourse Meta!

Você vai querer postar isso em Support

Olá a todos, estamos auto-hospedando o vLLM e gerando tokens de API com Fernet, que possuem o sinal “=”. Pelo que parece, verificando em /var/discourse/shared/standalone/log/var-log/nginx/error.log, o sinal “=” está sendo substituído por “%3D” e, portanto, minha solicitação não está sendo autorizada.

Isso poderia ser o caso? Poderia ser resolvido?

Obrigado pela contribuição.

Meu caso é bem simples. Já temos os serviços vLLM e openWebUI expondo LLMs para o mundo. Ambos funcionam bem. Também consigo verificar com chamadas cURL simples que posso acessar ambos de dentro do contêiner Discourse:

vLLM:

curl -v ${LLM_URL} -H "Content-Type: application/json" -H "Authorization: Bearer ${LLM_TOKEN}" \

-d '{

"model": "'"${LLM_MODEL}"'",

"prompt": "'"${TEST_PROMPT}"'",

"max_tokens": 128,

"temperature": 0

}'

openWebUI:

curl -v ${LLM_URL} -H "Content-Type: application/json" -H "Authorization: Bearer ${LLM_TOKEN}" \

-d '{

"model": "'"${LLM_MODEL}"'",

"messages": [

{ "role": "user",

"content": "'"${TEST_PROMPT}"'"

}

]

}'

Agora instalei o plugin discourse-ai em um Discourse auto-hospedado e tentei configurar o acesso via “LLMs”-“>“Configuração manual”-”>Provider=vLLM. Em ambos os casos, preciso fornecer a CHAVE API. Infelizmente… nenhum funciona:

vLLM com token Fernet retorna “error”:“Não autorizado”}

openWebUI retorna "{“detail”:“Não autenticado”}

Minha suspeita é que o token Fernet falha devido ao sinal “=” convertido para “%3D”, mas estou ainda mais intrigado com o openWebUI por causa de “Não autenticado”, enquanto o token é apenas uma string.

Não tenho ideia de como o plugin “discourse-ai” envia o token/API_KEY no caso do vLLM, mas espero que seja via cabeçalho "Bearer ".

Qualquer ajuda é bem-vinda ou experiência na configuração do vLLM com API_KEY

Tente definir o provedor de API como OpenAI se você precisar da API no formato de token de portador.

Isso funcionou pelo menos para o openWebUI! Muito obrigado!

2 posts foram divididos em um novo tópico: Melhores modelos e prompts para testar a pesquisa e descobertas do Discord

Estou com um problema relacionado à saída da IA no meu fórum. O idioma do meu fórum é “Árabe”, então ele deve ser configurado para definir o idioma da saída da IA para que se ajuste ao idioma do fórum, pois não é apropriado pedir um resumo do tópico e todo o tópico em árabe e a saída está vindo para mim em “Inglês”.

Diga nos prompts que a IA deve responder em árabe. Em teoria, “responder usando o mesmo idioma” também deveria funcionar, mas raramente funcionou para mim, no contexto finlandês com os modelos da OpenAI de qualquer forma.

Então, você tem uma configuração e esse é o prompt do sistema do agente/pessoa de IA usado.

Faz sentido usar esse comportamento como padrão quando um idioma diferente do inglês é detectado?

Estou repetindo todas as personas usando espanhol, é difícil mantê-las atualizadas com tantas (boas) mudanças.

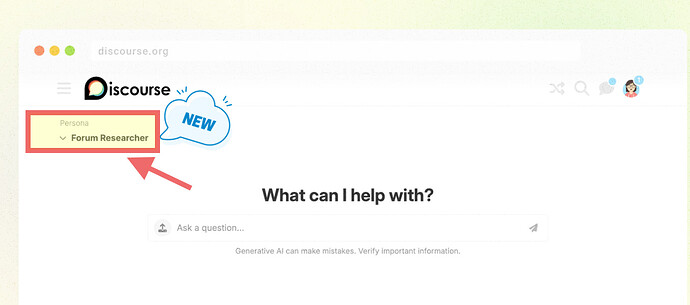

Você pode configurá-lo na aba Personas do plugin de IA.