Dieser Leitfaden erklärt, wie Sie die native Unterstützung für PDF- und Dokumentenanhänge aktivieren und nutzen können, wenn Sie mit KI-Bots in Discourse interagieren. Benutzer können PDFs und andere Dokumente direkt in Gesprächen mit KI-Agenten hochladen.

Erforderliches Benutzerniveau: Administrator

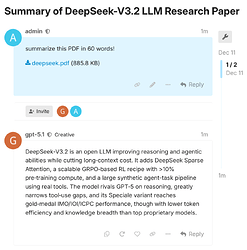

Zusammenfassung

Discourse AI unterstützt jetzt die native Handhabung von Anhängen, wodurch Benutzer PDFs und andere Dokumenttypen direkt beim Gespräch mit KI-Bots hochladen können. Die KI kann den Inhalt dieser Anhänge lesen und verstehen, was Anwendungsfälle wie Dokumentenanalyse, Zusammenfassung und Frage-Antwort-Funktionen basierend auf hochgeladenen Dateien ermöglicht.

Diese Funktion erfordert:

- Konfigurierte zulässige Anhangtypen beim LLM

- Einen Agenten, bei dem Vision aktiviert ist (dies steuert, ob Uploads in Nachrichten einbezogen werden)

- Die Dateierweiterung muss in den Upload-Einstellungen Ihrer Site autorisiert sein

Unterstützte Anbieter

Die native Anhangsunterstützung funktioniert mit Modellen der folgenden Anbieter:

- Anthropic (Claude-Modelle)

- AWS Bedrock (Claude-Modelle über Bedrock)

- Google (Gemini-Modelle)

- OpenAI (GPT-Modelle)

- Azure (OpenAI-kompatible Modelle)

- OpenRouter (OpenAI-kompatible Modelle)

Jeder Anbieter behandelt Anhänge auf API-Ebene anders, aber Discourse AI verwaltet dies automatisch. Beachten Sie, dass verschiedene Anbieter unterschiedliche Unterstützungsgrade für verschiedene Anhangtypen implementieren.

Unterstützte Anhangstypen

Die folgenden Dokumenttypen können für die KI-Verarbeitung konfiguriert werden:

| Typ | Erweiterungen |

|---|---|

pdf |

|

| Nur Text | txt |

| Microsoft Word | doc, docx |

| Rich Text Format | rtf |

| HTML | html, htm |

| Markdown | md, markdown |

![]() Bilder werden separat über die Einstellung „Vision enabled“ (Vision aktiviert) behandelt und erfordern keine Konfiguration des Anhangstyps.

Bilder werden separat über die Einstellung „Vision enabled“ (Vision aktiviert) behandelt und erfordern keine Konfiguration des Anhangstyps.

Konfiguration

Schritt 1: Dateierweiterungen für den Upload autorisieren

Bevor Benutzer Anhänge hochladen können, stellen Sie sicher, dass die Dateierweiterungen in Ihren Site-Einstellungen autorisiert sind.

- Navigieren Sie zu Admin → Files (Dateien)

- Suchen Sie die Einstellung

authorized extensions(autorisierte Erweiterungen) - Fügen Sie die Erweiterungen hinzu, die Sie zulassen möchten (z. B.

pdf|txt|docx)

Schritt 2: Das LLM-Modell konfigurieren

- Navigieren Sie zu Admin → Plugins → Discourse AI → LLMs

- Wählen Sie das LLM-Modell aus, das Sie konfigurieren möchten (oder erstellen Sie ein neues)

- Wählen Sie im Feld Allowed attachments (Zulässige Anhänge) die Dateierweiterungen aus oder geben Sie diese ein, die das Modell akzeptieren soll (z. B.

pdf,txt,docx)

![]() Wenn Sie das Feld „Allowed attachments“ leer lassen, werden Dokumentenanhänge für dieses Modell deaktiviert. Bilder werden separat über den Schalter „Vision enabled“ gesteuert.

Wenn Sie das Feld „Allowed attachments“ leer lassen, werden Dokumentenanhänge für dieses Modell deaktiviert. Bilder werden separat über den Schalter „Vision enabled“ gesteuert.

Schritt 3: Den Agenten konfigurieren

- Navigieren Sie zu Admin → Plugins → Discourse AI → Agents

- Wählen Sie einen Agenten aus oder erstellen Sie einen neuen

- Stellen Sie sicher, dass Vision enabled (Vision aktiviert) eingeschaltet ist – dies steuert, ob Uploads (sowohl Bilder als auch Dokumente) in Nachrichten, die an das LLM gesendet werden, einbezogen werden

- Setzen Sie das Default model (Standardmodell) auf ein LLM, für das Anhänge konfiguriert sind

Funktionsweise

Wenn ein Benutzer ein Dokument in einem Gespräch mit einem KI-Bot hochlädt:

- Das Dokument wird über die Standard-Upload-Verarbeitung an Discourse hochgeladen

- Discourse AI kodiert den Dokumentinhalt (base64)

- Der kodierte Inhalt wird zusammen mit der Nachricht des Benutzers an das LLM gesendet

- Das LLM verarbeitet sowohl die Textnachricht als auch den Dokumentinhalt

- Die KI antwortet basierend auf dem kombinierten Kontext

Technische Details

- Dokumente werden als base64 kodiert und inline mit der Anfrage gesendet

- Jeder Anbieter erhält Anhänge in seinem nativen Format:

- Anthropic: Verwendet den Typ

documentmit base64-Quelle - Gemini: Verwendet das Format

inlineData - OpenAI (Chat Completions API): Verwendet den Typ

filemitfile_data, das den base64-Inhalt enthält - OpenAI (Responses API): Verwendet den Typ

input_filemitfile_data, das den base64-Inhalt enthält

- Anthropic: Verwendet den Typ

- Dateigrößenbeschränkungen werden durch die Einstellung Ihrer Site

max attachment size kb(maximale Anhangsgröße in KB) geregelt

Anwendungsfälle

Die native Anhangsunterstützung ermöglicht mehrere Workflows:

- Dokumentenanalyse: Laden Sie Verträge, Berichte oder Forschungsarbeiten hoch, damit die KI diese zusammenfassen oder Fragen dazu beantworten kann

- Inhaltsprüfung: Lassen Sie die KI Entwurfsdokumente überprüfen und Feedback geben

- Datenextraktion: Extrahieren Sie bestimmte Informationen aus hochgeladenen Dokumenten

- Übersetzungshilfe: Laden Sie Dokumente in einer Sprache hoch und diskutieren Sie den Inhalt oder fordern Sie Übersetzungen an

- Technischer Support: Benutzer können Protokolldateien oder Konfigurationsdateien für die Fehlerbehebung hochladen

Einschränkungen

- Dateigröße: Anhänge werden durch die Upload-Größeneinstellungen Ihrer Site und den LLM-Anbieter begrenzt

- Anbieterunterstützung: Die Anhangsunterstützung erfordert einen Anbieter-Dialekt, der Dokumente verarbeitet (Anthropic, AWS Bedrock, Google, OpenAI, Azure und OpenRouter)

- Agent-Vision-Anforderung: Der Agent muss „Vision enabled“ (Vision aktiviert) eingeschaltet haben, damit Uploads in Nachrichten einbezogen werden

- Erweiterungsübereinstimmung: Die Dateierweiterung muss sowohl auf Ihrer Site für den Upload autorisiert als auch in der Konfiguration der Anhangstypen des LLM zugelassen sein

- Ergebnisse variieren: Da LLM-Anbieter und LLMs die Dateien verarbeiten, variieren Kosten/Genauigkeit und Ergebnisse. Anthropic neigt dazu, mehr Tokens für die Analyse zu verwenden als OpenAI oder Google.

- Caching aktivieren: Stellen Sie für Open AI sicher, dass Sie die Responses API verwenden, die eine konsistentere Unterstützung für das Caching bietet (wenn „thinking“ aktiviert ist). Für Anthropic-Modelle müssen Sie das Caching möglicherweise explizit in der LLM-Konfiguration aktivieren. Dies kann besonders wichtig sein, wenn Sie Gespräche mit mehreren Wendungen führen.

Fehlerbehebung

Anhänge werden nicht verarbeitet

- Überprüfen Sie, ob die Dateierweiterung in der Einstellung

authorized extensionsIhrer Site enthalten ist - Bestätigen Sie, dass der Dateityp in der Einstellung „Allowed attachments“ (Zulässige Anhänge) des LLM aufgeführt ist

- Stellen Sie sicher, dass der Agent „Vision enabled“ (Vision aktiviert) hat und ein korrekt konfiguriertes LLM verwendet

Upload schlägt fehl

- Überprüfen Sie Ihre Einstellung

max attachment size kb(maximale Anhangsgröße in KB) - Vergewissern Sie sich, dass die Dateierweiterung autorisiert ist

- Sehr große PDFs werden möglicherweise nicht unterstützt; jeder LLM-Anbieter hat unterschiedliche maximale Upload-Größen.

KI versteht das Dokument nicht

- Stellen Sie sicher, dass Sie ein Modell verwenden, das das Verständnis von Dokumenten unterstützt

- Versuchen Sie ein leistungsfähigeres Modell (z. B. Claude Sonnet 4.5, GPT-5.1, Gemini Pro 3)

FAQs

Können Benutzer mehrere Dokumente in einer einzigen Nachricht hochladen?

Ja, Benutzer können mehrere Anhänge in einer einzigen Nachricht hinzufügen, und die KI hat Zugriff auf alle davon.

Funktioniert dies sowohl im Chat als auch in privaten Nachrichten?

Ja, die Anhangsunterstützung funktioniert sowohl in privaten Nachrichten mit KI-Bots als auch in direkten Chat-Nachrichten, vorausgesetzt, der Agent ist für diese Interaktionsmethoden konfiguriert.

Ist dies anders als RAG-Uploads bei Agenten?

Ja. RAG-Uploads sind Dokumente, die Administratoren zur Wissensbasis eines Agenten hinzufügen, die indexiert und durchsucht werden. Die native Anhangsunterstützung ermöglicht es Endbenutzern, Dokumente während Gesprächen hochzuladen, um sie sofort zu analysieren, ohne sie zu indexieren.

Was geschieht mit hochgeladenen Dokumenten?

Dokumente werden gemäß den Standard-Upload-Verarbeitungs- und Aufbewahrungsrichtlinien Ihrer Site verarbeitet. Sie werden als normale Discourse-Uploads gespeichert.