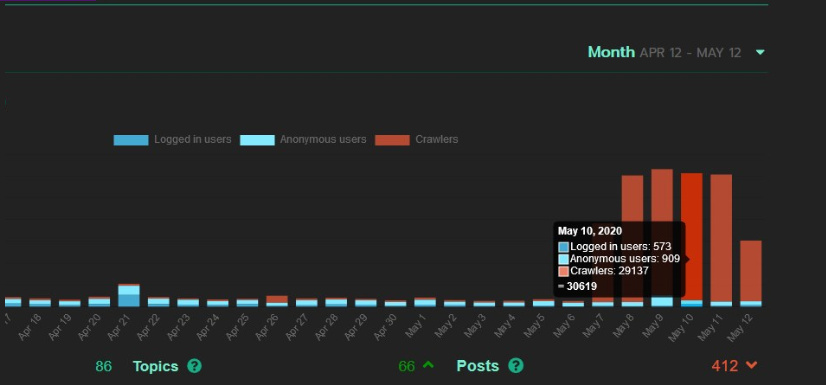

Je pense que la valeur est trop élevée. Y a-t-il un problème ?

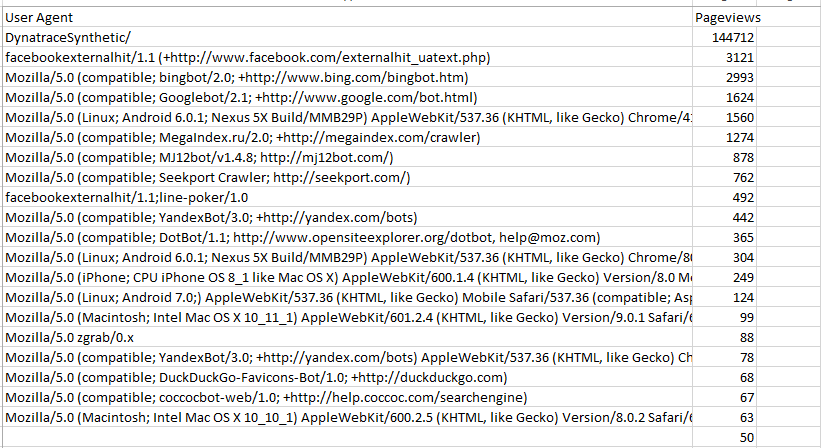

Vous pouvez voir qui c’est :

/admin/reports/web_crawlers

Et les ajouter ici :

admin/site_settings/category/all_results?filter=crawler user agents

Il y a eu beaucoup d’instabilité concernant les règles de crawling récemment en raison du changement de comportement de robots.txt par Google, donc cela peut être normal.

D’accord, merci beaucoup.

Sauf indication contraire de vos données, un robot indésirable est en action ! Bloquez-le via les paramètres de votre site.