Ei, você pode configurar seu próprio LLM personalizado usando o endpoint atual deles, api_key e ajustando o modelo com suas opções e parâmetros.

A lista inicial provavelmente precisa ser atualizada e pode ser mais intuitiva para novos usuários, mas você pode fazer o que quiser, com certeza.

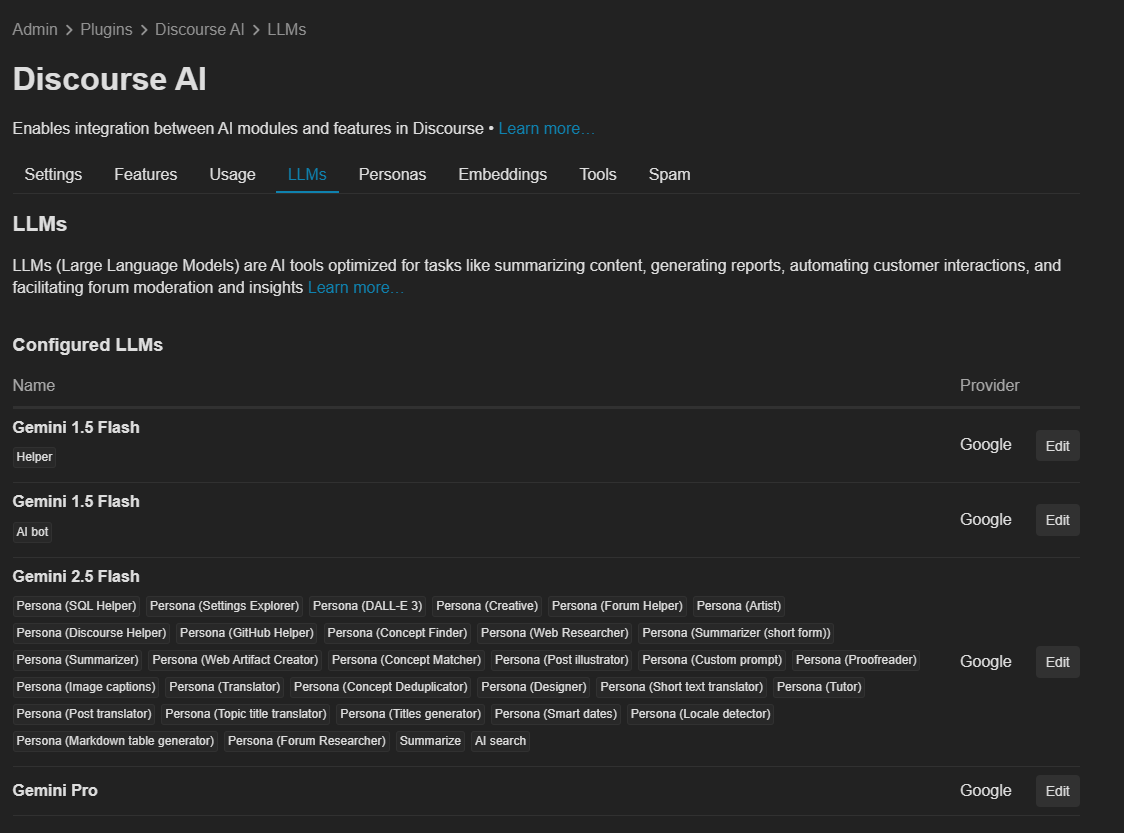

Hmm, tenho vários LLMs configurados, tentando colocar o máximo deles possível no 2.5 flash.

Não vejo como atribuir o Helper e o AI bot ao LLM Gemini Flash 2.5. Você está dizendo que preciso editar o LLM atribuído (Gemini 1.5 flash) e alterar a chave/endpoints etc para usar o 2.5 flash?

está sob as personas

Obrigado, sim, cheguei a esse ponto, vejo que algumas pessoas têm apenas uma opção, mas estranhamente elas estão esmaecidas para todas as personas. Também não vejo nenhuma ferramenta configurada em Discourse AI → Ferramentas.

Existe um guia sobre como configurar isso?

Sim, você pode começar agora aqui:

Obrigado, sim, já passei (e postei de volta) por eles anteriormente e revisei novamente para atualizações. Não consigo encontrar nada relacionado às minhas perguntas acima, especificamente:

- Como configuro o Bot de IA para responder automaticamente às postagens do OP e de todos os usuários. Pelo que entendi, preciso adicionar a ferramenta “read” à configuração da persona (presumo que a Persona Auxiliar de IA), mas não há uma ferramenta chamada “read” e a opção de ferramentas habilitadas está desativada. Não consigo encontrar nenhuma informação sobre isso nos links acima.

- Como configuro o Bot de IA para usar o modelo Gemini 2.5 Flash, não há uma opção específica para atribuir um modelo ao Bot de IA como há para as personas. Eu só preciso editar o modelo atualmente atribuído ao Bot de IA e fazê-lo usar o 2.5 flash?

Obrigado antecipadamente.

Talvez isso ajude você

Perfeito, era o que eu precisava, mas responderei às minhas perguntas acima para referência de outras pessoas que estão começando.

Habilite primeiro o plugin de Automação e, em seguida, crie uma Automação usando o link de como fazer do AI Triage acima, de Moin. Observe que, se você estiver usando as personas integradas como Forum Helper, você NÃO PODE ajustar as configurações de Ferramentas Habilitadas e Ferramentas Forçadas. Se você quiser personalizar essas configurações, precisará criar uma persona nova/personalizada. Quanto às ferramentas, read etc., estas são ferramentas integradas e você não precisa criar nenhuma ferramenta personalizada para acessá-las, no entanto, elas estarão disponíveis apenas através de personas personalizadas (as personas integradas terão as opções desativadas).

Percebi que o Bot de IA e o Helper são dois agentes especiais que têm seus próprios modelos de LLM atribuídos. Se eu precisar mudar qual LLM eles estão usando, preciso ir até os LLMs atribuídos a eles e atualizar a configuração diretamente em suas respectivas configurações. Não posso criar um modelo de LLM personalizado e, em seguida, reatribuir esses dois agentes para usá-los como se pode fazer com personas.

7 posts foram divididos em um novo tópico: Controlando respostas de IA em discussões de fóruns

Um ótimo recurso seria permitir a personalização do menu suspenso do bot para incluir logotipos de provedores e texto de subscrito para parâmetros específicos do modelo. Exemplo:

“(logo do provedor) nome do modelo

Contexto de 256k | 3B parâmetros”

Olá!

Estou testando o bot de IA em nosso fórum. É possível limitar o que o bot de IA pode ler? Ele está em todos os grupos automaticamente e parece que não consigo mudar isso. A questão surgiu porque há uma preocupação de que ele possa ler as mensagens privadas dos usuários. Não tenho certeza se ele pode fazer isso. Obrigado!

David

Alguém pode explicar a origem deste erro ao usar o Claude 4.6? (Eu tinha o Claude 4.5 antes e funcionou bem)

{“type”:“error”,“error”:{“type”:“invalid_request_error”,“message”:“Este modelo não suporta preenchimento antecipado de mensagem do assistente. A conversa deve terminar com uma mensagem do usuário.”},“request_id”:“req_011CYqkqNGbr3”}

Sim, eu posso ![]()

A Anthropic descontinuou alguns cabeçalhos beta, certifique-se de puxar a versão mais recente e tentar novamente, eu corrigi

Alguém já implementou isso no site deles?

Por favor, compartilhe os detalhes

Muitas pessoas implementaram isso, se você tiver alguma dúvida específica, sinta-se à vontade para abrir um tópico