تم تقسيم منشورين إلى موضوع جديد: هل من الممكن تمكين شخصية ذكاء اصطناعي واحدة فقط؟

RAILS_ENV=production bundle exec rake assets:precompile إصدار discourse المستضاف ذاتيًا لا يعمل مع أحدث إضافة discourse-AI بسبب أخطاء تجميع scss. يجب أن يكون @use “lib/viewport” السطر الأول من discourse-ai.css. هل يمكنك التحقق من فضلك؟

هل تستخدم هذا مع إصدار سابق من Discourse أم أنه على الفرع الرئيسي؟

بعد تثبيت إضافة Discourse AI على الإصدار المستقر من Discourse (3.4.6)، أدركت أن Discourse يقول إن #bdef136 (التزام بتاريخ 4 فبراير 2025) هو أحدث التزام، وأن الإضافة المثبتة حاليًا هي الأحدث.

ومع ذلك، عندما تحققت مرة أخرى بسبب وجود مشكلة حيث لم يتم عرض الحقول الرئيسية المطلوبة لدمج AWS Bedrock، وجدت أنها متأخرة بحوالي 300 التزام على الأقل، وعندما ذهبت فعليًا إلى مستودع discourse-ai وتحققت من الفرع الرئيسي، كان الفارق كبيرًا. تظهر هذه الأعراض أيضًا في مثيلات Discourse الأخرى التي أديرها، ولا يمكنني معرفة المشكلة.

لم يمر حتى أسبوع منذ أن قمت بتثبيت إضافة discourse-ai على مثيلي الحالي، ولكن التزام الإصدار الذي تم تثبيته فعليًا يعود إلى أكثر من 4-5 أشهر، وأنا أتساءل عن سبب ظهوره على أنه الأحدث، وكيفية إصلاحه حتى يمكن استبدال الإضافة بأحدث التزام.

تثبيت الإضافات (Plugins) بعد الإصدار المستقر. هذا يعني أنك لن تحصل تلقائيًا على تحديثات أحدث للإضافات التي قد تعتمد على تغييرات في نواة Discourse (Discourse core) التي لم يتم تضمينها في الإصدار المستقر بعد.

إذا استخدم تحديث الإضافة رمزًا موجودًا فقط في أحدث فرع تم اجتياز الاختبارات فيه (tests-passed branch)، فقد يتعطل على الإصدار المستقر لأن هذا الرمز ببساطة غير موجود.

على سبيل المثال، بدأت إضافة الذكاء الاصطناعي (AI plugin) في استخدام مكتبة js-diff، والتي تمت إضافتها إلى نواة Discourse فقط بعد إصدار فبراير المستقر. لذلك، فإن أحدث إصدار من إضافة الذكاء الاصطناعي لن يعمل مع هذا الإصدار المستقر.

أوه، فهمت! إذن أمر git clone في ملف app.yml يضيف سلوكًا أكثر مما تم ذكره في هذا الملف! الآن أصبح الأمر منطقيًا. ![]()

الآن، عندما أقوم بتفعيل إضافة الذكاء الاصطناعي وأضيف نموذج لغوي كبير جديدًا في الإضافة، بصرف النظر عن كوني قادرًا على تحديد AWS Bedrock، لماذا لا تظهر حقلا إدخال معرف مفتاح الوصول لـ AWS Bedrock ومنطقة AWS Bedrock عند تحديد Bedrock كموفر، على عكس ما هو مذكور في هذه الوثيقة: Configuring Amazon Bedrock services

أنا أستخدم Discourse الإصدار 3.4.5، وإصدار إضافة الذكاء الاصطناعي هو 0.0.1

و bdef136.

نحن لا ندعم Discourse AI على Discourse المستقر، يرجى استخدام قناة الإصدار الافتراضية الخاصة بنا للحصول على أفضل تجربة.

![]() تم الآن تجميع هذه الإضافة مع Discourse core كجزء من Bundling more popular plugins with Discourse core. إذا كنت تستضيف بنفسك وتستخدم الإضافة، فأنت بحاجة إلى إزالتها من

تم الآن تجميع هذه الإضافة مع Discourse core كجزء من Bundling more popular plugins with Discourse core. إذا كنت تستضيف بنفسك وتستخدم الإضافة، فأنت بحاجة إلى إزالتها من app.yml قبل الترقية التالية.

أحاول إعداد هذه الإضافة مع Azure. نحن نتصل بـ OpenAI عبر بوابتنا الخاصة التي تستخدم Azure. كنت أحاول إجراء الإعداد باستخدام تكوين LLM يدوي يدويًا

المعالجة بواسطة DiscourseAi::Admin::AiLlmsController#test بصيغة JSON

المعلمات: {“ai_llm”=>{“max_prompt_tokens”=>“2000”, “api_key”=>“[FILTERED]”, “tokenizer”=>“DiscourseAi::Tokenizer::OpenAiTokenizer”, “url”=>“<OUR_URL>”, “display_name”=>“test-ai-gateway”, “name”=>“gpt-4_0613-pgo-amrs”, “provider”=>“azure”, “enabled_chat_bot”=>“true”, “vision_enabled”=>“false”}}

يبدو أن هذا لا يعمل. هل يمكن لأي شخص تقديم الطريقة الصحيحة لإعداد هذا؟

سؤالي:

عند استخدام نموذج ذكاء اصطناعي للترجمة النصية الكاملة، أجد أن النتائج متوسطة. أرغب في التبديل إلى نموذج ذكاء اصطناعي آخر لإعادة ترجمة المحتوى. كيف يمكنني إعادة ترجمة المنشورات التي تمت ترجمتها بالفعل باستخدام النموذج الجديد؟

بالإضافة إلى ذلك، هل هناك أي طريقة فعالة لعد عدد المنشورات التي تمت ترجمتها بالفعل بسرعة؟

في الوقت الحالي، ستحتاج إلى استخدام وحدة تحكم Rails أو PostgreSQL لحذف الترجمات الموجودة.

هناك صفحة الحالة في خارطة طريقنا مع تقدم لكل لغة في قائمة انتظار الترجمة.

عذرًا، لا يمكنني العثور على الجدول المحدد لحذفه. هل يمكنك إخباري باسم الجدول وأين هو مخطط تقدم الترجمة؟

مرحباً، هل سيكون هناك تحديث بخصوص GPT 5؟

مرحباً، لا يوجد إعلان رسمي بأن فريق Discourse قال شيئاً عن تحديثات GPT-5 أو وجوده على الإطلاق؛ ولكن إذا كنت تريده حقاً، فانتظر حتى يتم إصداره، حتى تتمكن من التحقق منه.

يجب أن يصل قريباً:

ملاحظة حول GPT-5، لقد كنت أستخدمه طوال اليوم، إنه جيد، ولكنه نموذج استدلالي لذا فهو بطيء.

لا تتردد في التلاعب بجهد الاستدلال، فعندما يكون منخفضاً تكون السرعة مقبولة، ولكنه أبطأ بكثير من 4.1.

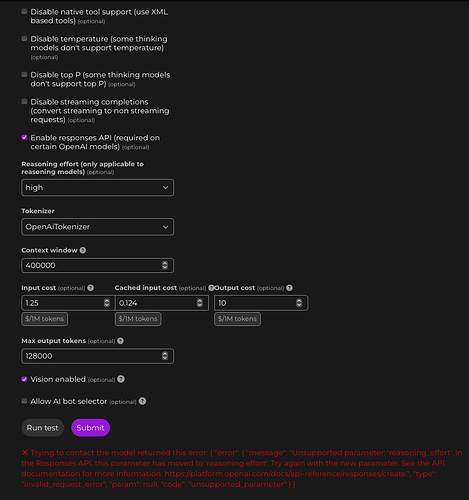

لقد قمت بسحب آخر تحديث ويبدو أن OpenAI قد أجرت بعض التغييرات على واجهة برمجة التطبيقات (API)

محاولة الاتصال بالنموذج أعادت هذا الخطأ: { “error”: { “message”: “معلمة غير مدعومة: ‘reasoning_effort’. في واجهة برمجة تطبيقات الردود، انتقلت هذه المعلمة إلى ‘reasoning.effort’. حاول مرة أخرى باستخدام المعلمة الجديدة. راجع وثائق واجهة برمجة التطبيقات لمزيد من المعلومات: https://platform.openai.com/docs/api-reference/responses/create.”، “type”: “invalid_request_error”، “param”: null، “code”: “unsupported_parameter” } }

لقد قمت بتعيين عنوان URL على https://api.openai.com/v1/responses هنا.

إنها تعمل ضمن واجهة برمجة تطبيقات الإكمال. سأتابع مع ثعلب لواجهات برمجة تطبيقات الاستجابات.

للعلم، GPT-5 مع الردود بطيء بشكل لا يصدق، والجميع يبلغ عن ذلك.

لقد قمت بدفع إصلاح لهذه المشكلة قبل ساعتين، جربها.

يعمل بشكل رائع يا رئيس ![]()

![]()