2 publicaciones se dividieron en un nuevo tema: Is it possible to enable only one AI persona?

RAILS_ENV=production bundle exec rake assets:precompile la versión autoalojada de Discourse no funciona con el último plugin de discourse-AI debido a errores de compilación de SCSS. @use “lib/viewport” debería ser la primera línea de discourse-ai.css. ¿podrías revisarlo, por favor?

¿Estás ejecutando esto contra una versión anterior de Discourse o está en main?

Después de instalar el plugin Discourse AI en la versión estable de Discourse (3.4.6), me di cuenta de que Discourse dice que #bdef136 (commit con fecha del 4 de febrero de 2025) es el último commit y que el plugin instalado actualmente es el más reciente.

Sin embargo, cuando volví a comprobar porque había un problema donde los campos clave requeridos para la integración de AWS Bedrock no se mostraban, descubrí que estaba al menos 300 commits atrasado, y cuando realmente fui al repositorio de discourse-ai y revisé la rama principal, la diferencia era grande. Este síntoma también aparece en otras instancias de Discourse que administro, y no puedo entender cuál es el problema.

Ni siquiera ha pasado una semana desde que instalé el plugin discourse-ai en mi instancia existente, pero el commit de la versión que se instaló realmente tiene más de 4-5 meses de antigüedad, y tengo curiosidad por saber por qué se muestra como la última y cómo solucionarlo para que el plugin pueda ser reemplazado por el último commit.

Los plugins se fijan después de una versión estable. Eso significa que no obtendrás automáticamente actualizaciones de plugins más nuevas que podrían depender de cambios en el núcleo de Discourse que aún no forman parte de la versión estable.

Si una actualización de plugin utiliza código que solo existe en la última rama “tests-passed”, podría fallar en la versión estable porque ese código simplemente no está allí.

Por ejemplo, el plugin de IA comenzó a usar la biblioteca js-diff, que solo se agregó al núcleo de Discourse después de la versión estable de febrero. Por lo tanto, la última versión del plugin de IA no funcionará con esa versión estable.

¡Oh, ya veo! ¡Así que el comando git clone en el archivo app.yml añade más comportamiento de lo que se mencionó en ese archivo! Ahora tiene sentido. ![]()

Ahora, cuando activo el plugin de IA y añado un nuevo LLM en el plugin, además de poder seleccionar AWS Bedrock, ¿por qué no aparecen los campos de entrada de ID de clave de acceso de AWS Bedrock y región de AWS Bedrock cuando selecciono Bedrock como proveedor, a diferencia de lo que se menciona en este documento: Configuring Amazon Bedrock services?

Estoy usando la versión 3.4.5 de Discourse, y la versión del plugin de IA es 0.0.1 y bdef136.

No soportamos Discourse AI en Discourse estable, por favor, utiliza nuestro canal de lanzamiento predeterminado para la mejor experiencia.

![]() Este plugin ahora está incluido en el núcleo de Discourse como parte de Bundling more popular plugins with Discourse core. Si te autoalojas y usas el plugin, necesitas eliminarlo de tu

Este plugin ahora está incluido en el núcleo de Discourse como parte de Bundling more popular plugins with Discourse core. Si te autoalojas y usas el plugin, necesitas eliminarlo de tu app.yml antes de tu próxima actualización.

Estoy intentando configurar este plugin con Azure. Nos conectamos a OpenAI a través de nuestra propia puerta de enlace que utiliza Azure. Estaba intentando configurar usando la configuración manual del LLM.

Procesando por DiscourseAi::Admin::AiLlmsController#test como JSON

Parámetros: {“ai_llm”=>{“max_prompt_tokens”=>“2000”, “api_key”=>“[FILTERED]”, “tokenizer”=>“DiscourseAi::Tokenizer::OpenAiTokenizer”, “url”=>“<OUR_URL>”, “display_name”=>“test-ai-gateway”, “name”=>“gpt-4_0613-pgo-amrs”, “provider”=>“azure”, “enabled_chat_bot”=>“true”, “vision_enabled”=>“false”}}

Esto no parece funcionar. ¿Alguien puede proporcionar la forma correcta de configurar esto?

Mi Pregunta:

Cuando utilizo un modelo de IA para la traducción de texto completo, los resultados me parecen mediocres. Quiero cambiar a otro modelo de IA para retraducir el contenido. ¿Cómo puedo retraducir publicaciones ya traducidas utilizando el nuevo modelo?

Además, ¿existe alguna forma eficiente de contar rápidamente el número de publicaciones que ya se han traducido?

Por el momento, necesitará usar la consola de Rails o PostgreSQL para eliminar las traducciones existentes.

Está en nuestra hoja de ruta añadir una página de estado con el progreso por idioma en el backlog de traducción.

Lo siento, no puedo encontrar la tabla específica para eliminar. ¿Puedes decirme el nombre de la tabla y dónde está el plan de progreso de la traducción?

Hola, ¿habrá una actualización sobre GPT 5?

Hola, no hay ningún anuncio oficial de que el equipo de Discourse haya dicho que GPT-5 se actualiza o existe en absoluto; pero si realmente lo quieres, solo espera hasta que se lance, para que puedas verificarlo.

Aterrizará en breve:

Nota sobre GPT-5: Lo he estado usando todo el día, es bueno, pero es un modelo de razonamiento, por lo que es lento.

Siéntete libre de jugar con el esfuerzo de razonamiento; con bajo es una velocidad aceptable, pero mucho más lento que 4.1.

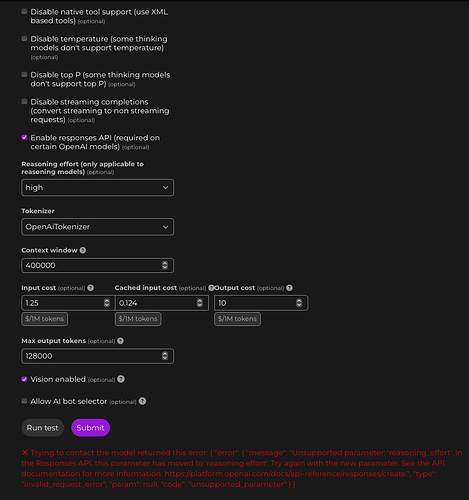

Descargué la última actualización y parece que OpenAI ha realizado algunos cambios en la API

Intentando contactar con el modelo devolvió este error: { “error”: { “message”: “Parámetro no compatible: ‘reasoning_effort’. En la API de Respuestas, este parámetro se ha movido a ‘reasoning.effort’. Inténtalo de nuevo con el nuevo parámetro. Consulta la documentación de la API para obtener más información: https://platform.openai.com/docs/api-reference/responses/create.”, “type”: “invalid_request_error”, “param”: null, “code”: “unsupported_parameter” } }

Tengo la URL configurada en https://api.openai.com/v1/responses aquí.

Está funcionando na API de completions. Darei seguimento com uma raposa para a API de respostas.

Para tu información, GPT-5 con Respuestas es increíblemente lento, según informan todos.

He implementado una solución para esto hace un par de horas, pruébala.

Funciona de maravilla, jefe ![]()

![]()