2 messages ont été divisés dans un nouveau sujet : Est-il possible de n’activer qu’une seule persona IA ?

RAILS_ENV=production bundle exec rake assets:precompile la version auto-hébergée de Discourse ne fonctionne pas avec le dernier plugin discourse-AI en raison d’erreurs de compilation SCSS. @use "lib/viewport" devrait être la première ligne de discourse-ai.css. Pouvez-vous vérifier s’il vous plaît ?

Exécutez-vous ceci sur une version antérieure de Discourse ou est-ce sur la branche principale ?

Après avoir installé le plugin Discourse AI sur la version stable de Discourse (3.4.6), j’ai réalisé que Discourse indiquait que #bdef136 (commit daté du 4 février 2025) était le dernier commit, et que le plugin actuellement installé était le plus récent.

Cependant, lorsque j’ai vérifié à nouveau parce qu’il y avait un problème où les champs clés requis pour l’intégration AWS Bedrock ne s’affichaient pas, j’ai découvert qu’il était en retard d’au moins 300 commits, et lorsque je suis allé dans le dépôt discourse-ai et que j’ai vérifié la branche principale, l’écart était important. Ce symptôme apparaît également sur d’autres instances Discourse que je gère, et je ne parviens pas à comprendre quel est le problème.

Il n’y a même pas une semaine que j’ai installé le plugin discourse-ai sur mon instance existante, mais le commit de la version qui a été réellement installée date de plus de 4-5 mois, et je suis curieux de savoir pourquoi il est indiqué comme étant le plus récent, et comment corriger cela afin que le plugin puisse être remplacé par le dernier commit.

Les plugins sont épinglés après une version stable. Cela signifie que vous ne recevrez pas automatiquement les mises à jour de plugins plus récentes qui pourraient dépendre de changements dans le noyau de Discourse qui ne font pas encore partie de la version stable.

Si une mise à jour de plugin utilise du code qui n’existe que dans la dernière branche tests-passed, elle pourrait échouer sur la version stable car ce code n’y est tout simplement pas présent.

Par exemple, le plugin AI a commencé à utiliser la bibliothèque js-diff, qui n’a été ajoutée au noyau de Discourse qu’après la version stable de février. La dernière version du plugin AI ne fonctionnera donc pas avec cette version stable.

Ah, je vois ! Donc la commande git clone dans le fichier app.yml ajoute plus de comportement que ce qui était mentionné dans ce fichier ! Maintenant, ça a du sens. ![]()

Maintenant, quand j’active le plugin IA et que j’ajoute un nouvel LLM dans le plugin, à part pouvoir sélectionner AWS Bedrock, pourquoi les champs de saisie AWS Bedrock Access Key ID et AWS Bedrock Region n’apparaissent-ils pas lorsque je sélectionne Bedrock comme fournisseur, contrairement à ce qui est mentionné dans ce document : Configuring Amazon Bedrock services

J’utilise la version 3.4.5 de Discourse, et la version du plugin IA est 0.0.1 et bdef136.

Nous ne prenons pas en charge Discourse AI sur Discourse stable, veuillez utiliser notre canal de publication par défaut pour une meilleure expérience.

![]() Ce plugin est maintenant inclus dans le cœur de Discourse dans le cadre de Bundling more popular plugins with Discourse core. Si vous auto-hébergez et utilisez le plugin, vous devez le supprimer de votre

Ce plugin est maintenant inclus dans le cœur de Discourse dans le cadre de Bundling more popular plugins with Discourse core. Si vous auto-hébergez et utilisez le plugin, vous devez le supprimer de votre app.yml avant votre prochaine mise à niveau.

J’essaie de configurer ce plugin avec Azure. Nous nous connectons à OpenAI via notre propre passerelle qui utilise Azure. J’essayais de faire le réglage en utilisant la configuration manuelle du LLM

Traitement par DiscourseAi::Admin::AiLlmsController#test en JSON

Paramètres : {"ai_llm"=\u003e{"max_prompt_tokens"=\u003e"2000", "api_key"=\u003e"[FILTERED]", "tokenizer"=\u003e"DiscourseAi::Tokenizer::OpenAiTokenizer", "url"=\u003e"\u003cOUR_URL\u003e", "display_name"=\u003e"test-ai-gateway", "name"=\u003e"gpt-4_0613-pgo-amrs", "provider"=\u003e"azure", "enabled_chat_bot"=\u003e"true", "vision_enabled"=\u003e"false"}}

Cela ne semble pas fonctionner. Quelqu’un peut-il fournir la bonne façon de configurer cela ?

Ma question :

Lorsque j’utilise un modèle d’IA pour la traduction de textes intégraux, je trouve les résultats médiocres. Je souhaite passer à un autre modèle d’IA pour retraduire le contenu. Comment puis-je retraduire des publications déjà traduites à l’aide du nouveau modèle ?

De plus, existe-t-il un moyen efficace de compter rapidement le nombre de publications qui ont déjà été traduites ?

Pour le moment, vous devrez utiliser la console Rails ou la console PostgreSQL pour supprimer les traductions existantes.

Il est prévu d’ajouter une page d’état avec la progression par langue dans le backlog de traduction.

Désolé, je ne trouve pas la table spécifique à supprimer. Pouvez-vous me donner le nom de la table et où se trouve la feuille de route de la progression de la traduction ?

Bonjour, y aura-t-il une mise à jour concernant GPT 5 ?

Salut, il n’y a pas d’annonce officielle de la part de l’équipe Discourse concernant des mises à jour ou l’existence de GPT-5 ; mais si vous le souhaitez vraiment, attendez simplement sa sortie pour pouvoir le vérifier.

Devrait atterrir bientôt :

Note sur GPT-5, je l’utilise toute la journée, il est bon, mais c’est un modèle de raisonnement donc il est lent

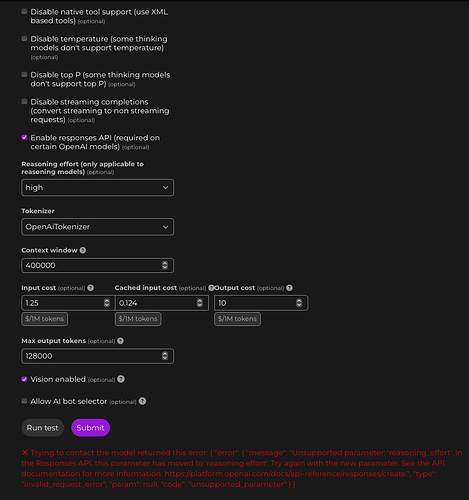

N’hésitez pas à jouer avec l’effort de raisonnement, à faible niveau, il est d’une vitesse acceptable, mais beaucoup plus lent que 4.1

J’ai récupéré la dernière mise à jour et il semble qu’OpenAI ait apporté des modifications à l’API

Essayer de contacter le modèle a renvoyé cette erreur : { “error”: { “message”: “Paramètre non pris en charge : ‘reasoning_effort’. Dans l'API Responses, ce paramètre a été déplacé vers ‘reasoning.effort’. Réessayez avec le nouveau paramètre. Voir la documentation de l'API pour plus d'informations : https://platform.openai.com/docs/api-reference/responses/create.”, “type”: “invalid_request_error”, “param”: null, “code”: “unsupported_parameter” } }

J’ai l’URL définie sur https://api.openai.com/v1/responses ici.

Cela fonctionne sous l’API des complétions. Je ferai un suivi avec un renard pour l’API des réponses.

Pour information, GPT-5 avec Réponses est incroyablement lent, tout le monde le signale.

J’ai poussé un correctif pour cela il y a quelques heures, essayez-le.

Fonctionne à merveille chef ![]()

![]()