شكرا جزيلا

هل يمكننا استخدام Deepseek؟

بالتأكيد، لديها واجهة برمجة تطبيقات متوافقة مع Open AI

من فضلك، لم أتمكن من العثور على هذا الإعداد (وكذلك الإعداد الذي أظهرته أنت في لقطة الشاشة الخاصة بك) في أي مكان ضمن المسؤول\u003e إعدادات الذكاء الاصطناعي.

هذا متاح ضمن الشخصيات، حدد شخصية معينة قابلة للتحرير (غير نظامية) وانظر أدناه للموجه

تم دمج 4 مشاركات في موضوع موجود: هل سيدعم RAG ملفات PDF في المستقبل؟

تم تقسيم المشاركات إلى موضوع جديد: توفير إشارة بصرية عندما يتلقى موضوع استجابة من الذكاء الاصطناعي

تم تقسيم منشورين إلى موضوع جديد: Ways to add knowledge to my persona

تم تقسيم منشورين إلى موضوع جديد: القلق بشأن الخصوصية الشخصية مع إضافة الذكاء الاصطناعي

مرحباً بك في Discourse Meta!

ستحتاج إلى نشر هذا في Support

مرحباً بالجميع، نحن نستضيف vLLM ذاتيًا ونقوم بإنشاء رموز API باستخدام Fernet، والتي تحتوي على علامة “=”. يبدو لي، من خلال التحقق في /var/discourse/shared/standalone/log/var-log/nginx/error.log، أن علامة “=” يتم استبدالها بـ “%3D” وبالتالي فإن طلبي غير مصرح به.

هل يمكن أن يكون هذا هو الحال؟ هل يمكن حلها؟

شكرًا على المساهمة.

قضيتي بسيطة نوعًا ما. لدينا بالفعل خدمات vLLM و openWebUI تعرض نماذج لغوية كبيرة (LLMs) للعالم. كلاهما يعمل بشكل جيد. يمكنني أيضًا التحقق باستدعاءات cURL بسيطة من أنه يمكنني بالفعل الوصول إلى كليهما من داخل حاوية Discourse:

vLLM:

curl -v ${LLM_URL} -H "Content-Type: application/json" -H "Authorization: Bearer ${LLM_TOKEN}" \

-d '{

"model": "'"${LLM_MODEL}"'",

"prompt": "'"${TEST_PROMPT}"'",

"max_tokens": 128,

"temperature": 0

}'

openWebUI:

curl -v ${LLM_URL} -H "Content-Type: application/json" -H "Authorization: Bearer ${LLM_TOKEN}" \

-d '{

"model": "'"${LLM_MODEL}"'",

"messages": [

{ "role": "user",

"content": "'"${TEST_PROMPT}"'"

}

]

}'

الآن قمت بتثبيت إضافة discourse-ai على Discourse مستضاف ذاتيًا وحاولت تكوين الوصول عبر “LLMs”-“>“تكوين يدوي”-”>Provider=vLLM. في كلتا الحالتين يجب عليّ تقديم مفتاح واجهة برمجة التطبيقات (API KEY). لسوء الحظ.. لا يعمل أي منها:

vLLM مع رمز Fernet يعيد “error”:“Unauthorized”}

openWebUI يعيد "{“detail”:“Not authenticated”}

اشتباهي هو أن رمز Fernet يفشل بسبب تحويل علامة “=” إلى “%3D” ولكنني أكثر حيرة مع openWebUI بسبب “Not authenticated”، بينما الرمز هو مجرد سلسلة.

ليس لدي أي فكرة عن كيفية إرسال إضافة “discourse-ai” للرمز/API_KEY في حالة vLLM ولكنني آمل أن يكون ذلك عبر عنوان "Bearer ".

نرحب بأي مساعدة أو خبرة في تكوين vLLM باستخدام API_KEY.

حاول تعيين مزود API على OpenAI إذا كنت بحاجة إلى API بتنسيق رمز bearer.

هذا نجح على الأقل لـ openWebUI! شكرا جزيلا!

تم تقسيم موضوعين إلى موضوع جديد: أفضل النماذج والمطالبات لاختبار بحث Discord والاكتشافات

لدي مشكلة تتعلق بمخرجات الذكاء الاصطناعي في منتداي. لغة المنتدى هي “العربية”، لذا يجب ضبط إعدادات لغة إخراج الذكاء الاصطناعي لتتناسب مع لغة المنتدى، حيث أنه من غير المناسب أن أطلب ملخصًا للموضوع وكل الموضوعات باللغة العربية، ثم يكون الناتج باللغة “الإنجليزية”.

أخبر في المطالبات أن الذكاء الاصطناعي يجب أن يستجيب باللغة العربية. من الناحية النظرية، يجب أن يعمل “الرد باستخدام نفس اللغة” أيضًا، ولكنه نادرًا ما نجح معي، في السياق الفنلندي مع نماذج OpenAI على أي حال.

إذن لديك إعداد وهذا هو مطالبة النظام لوكيل/شخص الذكاء الاصطناعي المستخدم.

هل من المنطقي استخدام هذا السلوك كإعداد افتراضي عند اكتشاف لغة أخرى غير الإنجليزية؟

أنا أكرر جميع الشخصيات باستخدام اللغة الإسبانية، ومن الصعب تحديثها مع وجود الكثير من التغييرات (الجيدة).

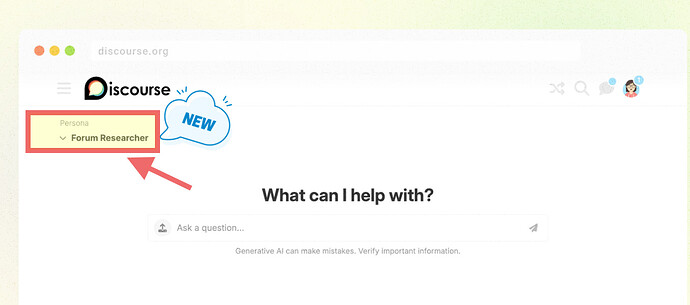

يمكنك تكوينه في علامة التبويب “الشخصيات” (Personas) الخاصة بمكون AI الإضافي.