SidV

1

……将其打造为一个健康的数字空间。

所有社区都从零级开始,并会持续增长,直到管理团队感到……并开始分析为何有些讨论话题已发布多年却无人问津。您是否需要保留该主题?我们是否应该将其归档?还是直接删除?

如果我们将其归档,搜索引擎爬虫仍会继续索引该内容,因此它仍可能为论坛带来新读者。但……它真的还有用吗?或者删除是否更好?

另一方面,如果我们删除它,可以释放资源,并促使新来的社区成员就未发布(或已归档)的内容开启全新、鲜活的讨论。

就我而言,我的论坛在过去30天内访问量已接近50万次,我希望更好地优化向外界展示的内容。

如何优化内容?如何恰当地清理旧内容?

目前正在执行的一些任务包括:

还可以采取哪些措施?

任何建议都欢迎。

8 个赞

HAWK

(Hawk)

2

好问题

了解您拥有哪种类型的社区会很有帮助。我的想法在支持社区和 CoP(例如)之间有所不同。

3 个赞

SidV

3

感谢你的回复,Sarah。我知道你是一位数字社区顾问,因此你在该领域的经验将非常有帮助。非常希望能听到你对这两类社区的看法。

就我个人而言,自2008年以来,我一直从事ERP咨询工作,特别是SAP系统。多年来,我为企业和最终用户提供信息与支持,他们和我一样,都是从零开始学习该系统的。随着时间的推移,我们逐渐对咨询这一职业产生了一种难以割舍的热爱。

我通常负责管理支持类社区,而本项目是我目前规模最大的一个。我曾使用过其他系统,但可以肯定的是,Discourse 完全超出了我的所有预期。因此,我希望进一步优化它,持续进行内容调试和清理,为读者提供一个高质量、信息新颖的交流空间。

3 个赞

HAWK

(Hawk)

4

好的。就支持社区而言,我认为这相当明确:删除不再最新或相关的内容。我假设任何过时的建议都已被更新的主题所取代,因此搜索者仍能找到结果。

6 个赞

SidV

5

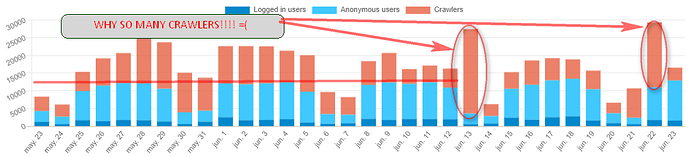

好吧,我现在正和这些“机器人”搏斗……

天哪,为什么有这么多来自机器人的页面浏览量!

我已经读过这个:How to block all crawlers but Google's - #12 by codinghorror

但是……我现在很头疼……屏蔽“所有”爬虫(除了 Google 机器人)可以吗?

2 个赞

HAWK

(Hawk)

6

你可以随心所欲地操作,但我会在这里谨慎一些。还有其他合法的机器人。

你为什么不深入查看爬虫报告,看看哪些机器人造成的干扰最大呢?

3 个赞

SidV

7

是的,当然,我忘了说明:我目前是按爬虫逐个进行清理管理,几乎每周分析一次,以识别哪个爬虫对网站的侵入最严重,然后逐个将其封禁。

我担心的是,将如此多的机器人加入黑名单可能会在某种程度上影响网站性能。

因此,我在想,与其逐个封禁,不如将必要的机器人加入白名单,然后封禁其他所有机器人。但……是否存在所谓的“必要追踪器”呢?

我搜索了论坛,看看是否有专门讨论必要爬虫的帖子,但未能找到。如果您知道相关主题,请告诉我。

1 个赞

Stephen

(Stephen)

8

如果你的网站是公开的,且 SEO 对你有价值,那么任何将你的数据添加到有用索引中的爬虫都是“必要的”。查看你的流量来源并与爬虫进行对比,是否存在相关性?

在这里,使用爬虫白名单可能是更好的解决方案,对吧?

3 个赞

SidV

9

如果 100% 代表整个自然流量来源,过去 30 天的情况如下:

我最近屏蔽的爬虫是:MegaIndex.ru/2.0

它是 6 月 22 日产生大量访问的元凶。该机器人带来了超过 20,000 次页面浏览量

4 个赞

j127

11

如果你使用 Cloudflare,可以通过它来拦截“恶意机器人”。不过我不确定效果如何。我曾暂时尝试过,它会拦截任何看似自动化的请求,甚至包括像 curl 这样的工具以及我自己调用 Discourse API 的脚本。

1 个赞