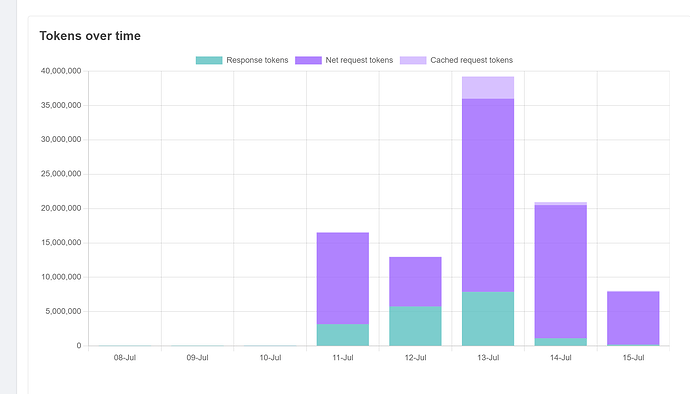

Segui o tutorial oficial para configurar o Discourse AI para tradução e defini-o para traduzir todas as postagens anteriores ao longo de vários dias. De fato, isso resultou em uma quantidade substancial de tokens de entrada e saída. No entanto, após dois dias, encontrei uma situação em que apenas os tokens de entrada estavam sendo processados, sem nenhuma saída. Não tenho certeza da causa — poderia ser que todas as postagens anteriores já foram traduzidas? Se sim, que medidas posso tomar para reduzir a entrada de tokens e, assim, economizar custos?

Olá, você seguiu estas recomendações?

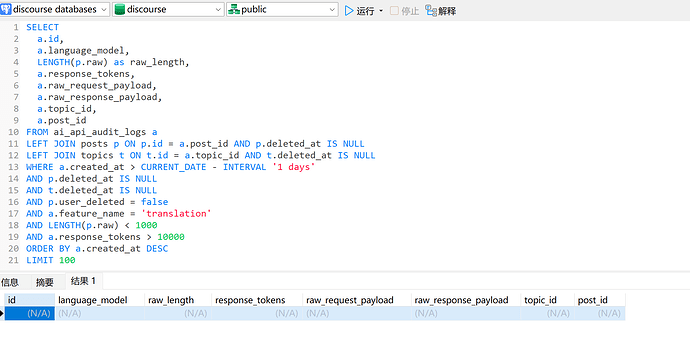

O gráfico de uso definitivamente parece preocupante. Você pode tentar esta consulta do explorador de dados:

SELECT

a.id,

a.language_model,

LENGTH(p.raw) as raw_length,

a.response_tokens,

a.raw_request_payload,

a.raw_response_payload,

a.topic_id,

a.post_id

FROM ai_api_audit_logs a

LEFT JOIN posts p ON p.id = a.post_id AND p.deleted_at IS NULL

LEFT JOIN topics t ON t.id = a.topic_id AND t.deleted_at IS NULL

WHERE a.created_at > CURRENT_DATE - INTERVAL '1 days'

AND p.deleted_at IS NULL

AND t.deleted_at IS NULL

AND p.user_deleted = false

AND a.feature_name = 'translation'

AND LENGTH(p.raw) < 1000

AND a.response_tokens > 10000

ORDER BY a.created_at DESC

LIMIT 100

A consulta deve mostrar o número de tokens de resposta usados com base no comprimento bruto do post. Idealmente, você deve ver um número semelhante, não mais que 1,5x tokens. O AiApiAuditLog ajudará a determinar o que está acontecendo.

Além disso, por favor, compartilhe:

- Qual modelo você está usando?

- Qual é a sua taxa de preenchimento por hora? Sugiro mantê-la em um valor baixo, como 50 para começar.

- Quantos idiomas você está suportando? O modelo selecionado os suporta?

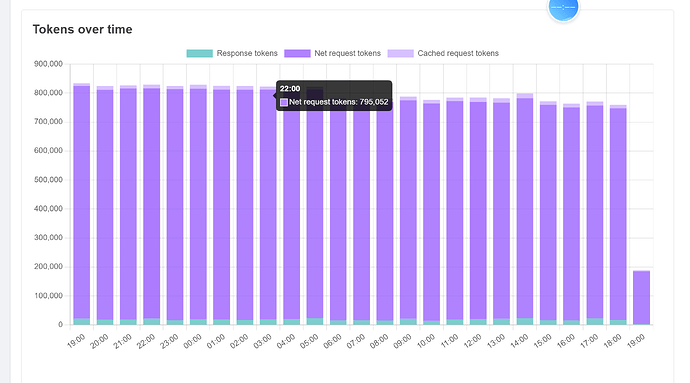

Eu configurei o GPT-4.1 Nano como o modelo de tradução. A taxa de backfill horária foi anteriormente definida em 1.000, mas hoje a ajustei para 100. Habilitei o suporte para japonês e inglês, e este modelo de fato suporta esses idiomas.

Sim, 1000 provavelmente não é uma boa ideia e eu deveria adicionar um limite de configuração do site aqui.

Não tenho certeza de como a API da OpenAI lida com ser atingida cerca de 3000 vezes por hora. Basicamente, para sua configuração, por postagem, fazemos: 1: detecção de local, 2: tradução para japonês, 3: tradução para inglês.

Sugiro reduzir ainda para 50 e ver como funciona.

Implementaremos uma maneira de visualizar o progresso da tradução de todo o site também em um futuro próximo.

Hmm essa consulta deve funcionar. Você tem o plugin discourse-data-explorer?

Muito bem, vou tentar primeiro. Obrigado.

Vou instalá-lo depois e tentar novamente. Atualmente, reconstruir o fórum não é viável porque os usuários ainda o estão utilizando ativamente.