Récemment, @neil a ajouté un support natif pour l’analyse du trafic des robots d’exploration ainsi que la possibilité de bloquer ou d’autoriser spécifiquement les user-agents de ces robots.

Une chose est immédiatement apparue : Bing, de manière constante, sur plusieurs sites, génère une charge nettement plus élevée que tout autre robot d’exploration.

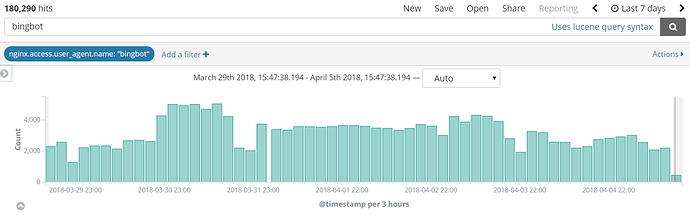

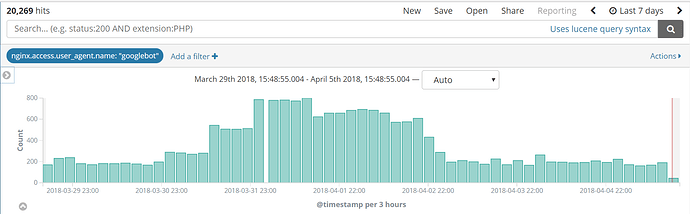

Par exemple, sur Meta, nous avons observé sur une période d’environ une semaine les chiffres suivants :

| User Agent | Pageviews |

|---|---|

| Mozilla/5.0 (compatible; bingbot/2.0; +http://www.bing.com/bingbot.htm) | 183236 |

| Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | 16117 |

| Mozilla/5.0 (compatible; YandexBot/3.0; +http://yandex.com/bots) | 15959 |

| Mozilla/5.0 (compatible; AhrefsBot/5.2; +http://ahrefs.com/robot/) | 9450 |

| Mozilla/5.0 (compatible; Baiduspider/2.0; +http://www.baidu.com/search/spider.html) | 5022 |

Mozilla/5.0 (compatible; DotBot/1.1; http://www.opensiteexplorer.org/dotbot, help@moz.com) |

4498 |

| Sogou web spider/4.0(+http://www.sogou.com/docs/help/webmasters.htm#07) | 3976 |

Bing explore Meta à plus de 10 fois la vitesse de tout autre robot. En examinant nos journaux plus détaillés, la tendance est très claire (et a également été vérifiée) :

En regardant une carte géographique, nous pouvons voir que le trafic provient très probablement de Microsoft.

En examinant des adresses IP spécifiques, je peux confirmer que cela provient bien de Microsoft grâce à des recherches d’IP inversées.

Bing n’hésite pas à accéder à Meta plus de 5000 fois sur une période de 3 heures, tandis que Google ne dépasse jamais 800 requêtes en pic et fonctionne généralement beaucoup plus lentement.

Suite à ce commit, Bing est désormais limité par défaut à une requête toutes les 60 secondes :

Vous pouvez supprimer ce ralentissement pour Bing en modifiant votre paramètre slow_down_crawler_user_agents, mais nous ne le recommandons pas sauf si vous comprenez les conséquences sur le trafic des robots d’exploration.

Nous avons pris cette mesure pour protéger les sites Discourse contre les attaques des robots de Microsoft. Je ne sais pas pourquoi Bing se comporte si mal ; ma théorie est que cela est dû au fait qu’il tente constamment de revalider les liens canoniques. Dans les journaux, je vois qu’il essaie trois fois par semaine de déterminer quelle est la page canonique pour un lien vers un sujet. Par exemple :

Même si nous indiquons à Bing que le lien canonique pour https://meta.discourse.org/t/topic-stopwatch-theme-component/83939/20 est https://meta.discourse.org/t/topic-stopwatch-theme-component/83939, il semble ne pas nous « faire confiance » et doit vérifier à nouveau trois fois par semaine.

Nous sommes en contact avec Microsoft à ce sujet et ils travaillent sur une solution de leur côté, mais la résolution prendra des mois, voire des années. Cette mesure est donc nécessaire pour la protection de tous en attendant.