Questa guida spiega l’agente Forum Researcher in Discourse AI, come funziona e come configurarlo per un’analisi approfondita dei contenuti del forum.

Livello utente richiesto: Amministratore (per abilitare e configurare), Tutti gli utenti (per interagire, se viene concessa l’accesso)

Comprendere e utilizzare l’agente Forum Researcher

Il plugin Discourse AI include l’agente Forum Researcher, uno strumento potente progettato per condurre ricerche approfondite sui contenuti all’interno del tuo forum. Questo agente può aiutarti a scoprire informazioni chiave, riassumere discussioni e analizzare le tendenze nella tua comunità.

Sommario

Questo documento coprirà:

- Come funziona l’agente Forum Researcher.

- Passaggi per configurare il Forum Researcher.

- Best practice per interagire con l’agente.

- La distinzione tra il Forum Researcher e gli strumenti di assistenza standard del forum.

- Indicazioni sulla selezione di un Modello Linguistico di grandi dimensioni (LLM) appropriato.

- Suggerimenti per il debug delle attività di ricerca.

- Limitazioni attuali dell’agente.

Come funziona

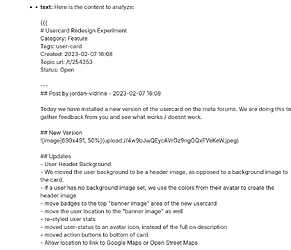

L’agente Forum Researcher utilizza uno strumento dedicato Researcher. Questo strumento è progettato per:

- Accedere ai contenuti del forum: Può leggere attraverso varie sezioni del tuo forum.

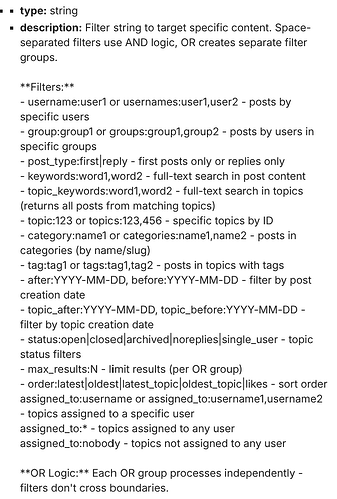

- Applicare filtri avanzati: Un sistema di filtri flessibile consente allo strumento di individuare informazioni pertinenti con precisione. Puoi specificare i contenuti tramite:

- Categorie specifiche (ad esempio,

category:supportocategories:support,feedback) - Tag (ad esempio,

tag:bugotags:bug,regression) - Utenti o gruppi (ad esempio,

username:sam,usernames:sam,jane,group:moderators,groups:moderators,admins) - Parole chiave nei post o nei titoli degli argomenti (ad esempio,

keywords:regression,bug,topic_keywords:feature,request) - Intervalli di date per i post (ad esempio,

after:2024-01-01 before:2024-06-30) - Intervalli di date per gli argomenti (ad esempio,

topic_after:2024-01-01 topic_before:2024-06-30) - Argomenti specifici per ID (ad esempio,

topic:123otopics:123,456) - Stato dell’argomento (ad esempio,

status:open,status:closed,status:archived,status:noreplies,status:single_user) - Tipo di post (ad esempio,

post_type:first,post_type:reply) - Ordine di ordinamento (ad esempio,

order:latest,order:oldest,order:latest_topic,order:oldest_topic,order:likes) - Limite dei risultati in linea (ad esempio,

max_results:50) - Argomenti assegnati (se il plugin Assegna è abilitato, ad esempio

assigned_to:username,assigned_to:user1,user2,assigned_to:*,assigned_to:nobody) - I filtri possono essere combinati utilizzando la logica AND (separati da spazi) o la logica OR (usando

ORtra gruppi di filtri). Ad esempio:category:bugs status:open after:2024-05-01 OR tag:critical usernames:sally.

- Categorie specifiche (ad esempio,

- Analizzare i contenuti con i Modelli Linguistici di grandi dimensioni (LLM): Dopo aver recuperato i contenuti filtrati, utilizza un LLM per analizzare le informazioni, estrarre approfondimenti e rispondere alle tue domande specifiche o raggiungere i tuoi obiettivi di ricerca.

- Seguire un processo strutturato: Per garantire efficienza e accuratezza, considerando i potenziali costi, il Forum Researcher è progettato per:

- Comprendere: Lavorerà con te per chiarire i tuoi obiettivi di ricerca all’inizio.

- Pianificare: In base ai tuoi obiettivi, progetta un approccio di ricerca completo utilizzando i filtri disponibili.

- Testare (Esecuzione a secco): Prima di eseguire l’analisi completa, l’agente esegue tipicamente una “esecuzione a secco”. Questo comporta il calcolo di quanti post corrispondono ai criteri di filtro senza elaborarli immediatamente con l’LLM. L’agente ti informerà quindi di questo conteggio.

- Raffinare: In base ai risultati dell’esecuzione a secco, se il numero di post è troppo alto (rischio di costi elevati o risultati troppo ampi) o troppo basso (potenziale perdita di informazioni chiave), l’agente può aiutarti a regolare i filtri.

- Eseguire: Una volta confermato che l’ambito è appropriato (dopo l’esecuzione a secco), l’agente esegue l’analisi finale, inviando i contenuti all’LLM.

- Riassumere: Presenta i risultati, tipicamente utilizzando Markdown di Discourse, con collegamenti ai post e agli argomenti originali del forum come prove di supporto.

Questo approccio metodico significa che puoi chiedere al ricercatore di eseguire compiti come:

- “Riassumi i bug irrisolti più discussi nella categoria ‘mobile-app’ nell’ultimo trimestre e identifica eventuali soluzioni proposte o workaround menzionati nelle discussioni.”

- “Aiutami a identificare le principali argomentazioni a favore e contro l’argomento della proposta ‘New User Onboarding’ (link) e elenca i principali sostenitori di ogni lato.”

- “Rivedi l’attività del gruppo ‘documentation-team’ nell’ultimo anno e fornisci un rapporto sui loro contributi chiave agli articoli how-to, evidenziando eventuali tutorial che hanno ricevuto un feedback positivo significativo.”

Configurazione del Forum Researcher

Il Forum Researcher è disabilitato per impostazione predefinita perché il suo utilizzo può comportare costi LLM.

- Abilita l’agente: Attivalo navigando in Amministratore → AI → Agenti.

- Controlla l’accesso: È fortemente raccomandato limitare questo agente a gruppi specifici per gestire i costi LLM. Puoi anche utilizzare quote AI per un controllo più fine.

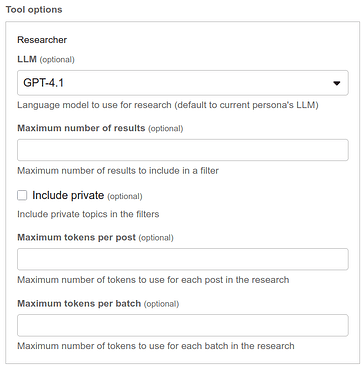

Una volta abilitato, lo strumento ha diverse opzioni di configurazione:

- LLM: Seleziona un LLM specifico per la ricerca. Questo è impostato di default sull’LLM dell’agente corrente. Questa opzione ti permette di bilanciare qualità e costo.

- Numero massimo di risultati: Questo limita il numero di post elaborati per query per controllare i costi. Il valore predefinito è 1000.

- Includi privati: Questo permette la ricerca in categorie sicure, utilizzando i permessi dell’utente che interagisce.

- Massimo token per post: Questo tronca i post lunghi per risparmiare sui costi dei token. Il valore predefinito è 2000 token, con un minimo di 50.

- Massimo token per batch: Questo controlla la dimensione del blocco di dati inviato all’LLM. È utile per LLM con finestre di contesto ampie o per mantenere il focus. Se impostato a 8000 o inferiore, è impostato di default sui token massimi del prompt dell’LLM meno un buffer di 2000 token.

Best practice per l’interazione

Per ottenere il massimo dal Forum Researcher gestendo i costi:

- Sii specifico con gli obiettivi: Definisci chiaramente cosa vuoi scoprire prima di iniziare. L’agente funziona meglio quando ha obiettivi precisi.

- Conferma l’ambito dopo l’esecuzione a secco: L’agente eseguirà tipicamente prima una ‘esecuzione a secco’ e ti informerà su quanti post ha trovato in base alla tua richiesta. Presta molta attenzione a questo numero. Se è troppo alto (rischio di costi elevati o risultati poco focalizzati) o troppo basso (potenziale perdita di informazioni cruciali), discuti con l’agente di affinare i tuoi filtri prima di impegnarti nell’analisi completa.

- Itera sui filtri: Se l’esecuzione a secco iniziale non individua le informazioni giuste, lavora con l’agente per regolare i criteri di filtro. Aggiungi parole chiave più specifiche, restringi gli intervalli di date o specifica categorie/tag.

- Consolida le query: L’agente è progettato per gestire più obiettivi correlati in una singola esecuzione di ricerca. Cerca di raggruppare domande correlate in un’unica richiesta di ricerca completa all’agente.

Relazione con gli strumenti di assistenza standard del forum e strumenti correlati

L’agente Forum Researcher è distinto da un Forum Helper generico che utilizza strumenti standard come Search e Read.

-

Strumenti standard

SearcheRead:- Lo strumento

Searchidentifica principalmente argomenti pertinenti. Lo fa confrontando parole chiave con il contenuto dei post e altri criteri (tag, categorie, ecc.). Per ogni argomento corrispondente, restituisce un collegamento e un breve estratto da un post rilevante, non il contenuto completo del post. - Lo strumento

Readè utilizzato per accedere al contenuto completo di un argomento specifico (o post selezionati al suo interno) identificato daSearch. - Questi strumenti lavorano in tandem per il recupero mirato:

Searchtrova gli argomenti,Readne elabora il contenuto.

- Lo strumento

-

Strumento

researcherdel Forum Researcher:- Analisi diretta e approfondita dei contenuti: Lo strumento

researchernon si limita a identificare gli argomenti; elabora e analizza direttamente il contenuto completo di potenzialmente molti post (fino alNumero massimo di risultaticonfigurato) che corrispondono ai suoi criteri di filtro completi. - Filtraggio avanzato e sintesi: Utilizza un linguaggio di filtraggio più complesso per costruire un set di dati di post da tutto il forum (potenzialmente comprendente centinaia di argomenti) e poi sintetizza le informazioni da questo intero set di dati per rispondere a domande complesse. Questo è fondamentalmente diverso dal leggere singoli argomenti uno per uno.

- Analisi diretta e approfondita dei contenuti: Lo strumento

In sostanza, mentre un Forum Helper utilizza Search per individuare argomenti (presentando estratti) e Read per approfondire uno di essi, il Forum Researcher conduce un’analisi ampia sul testo effettivo di molti post simultaneamente per scoprire approfondimenti più profondi e sintetizzati.

Quale LLM dovrei usare?

La tecnologia LLM sta evolvendo rapidamente, con modelli che migliorano continuamente in capacità e rapporto costo-efficacia. Durante lo sviluppo del Forum Researcher, modelli come Gemini 2.5 Flash, Gemini 2.5 Pro, GPT-4.1 e Claude 4 Sonnet hanno fornito risultati eccellenti per piani di ricerca complessi.

La scelta migliore dipende dalle tue esigenze specifiche:

- Analisi di alta qualità e sfumata: Modelli più avanzati potrebbero essere preferibili, sebbene di solito comportino costi più elevati.

- Panoramiche ampie o attività sensibili ai costi: Modelli più veloci ed economici possono essere molto efficaci.

Ecco alcuni esempi puntuali dai test interni di Discourse per una query molto specifica e complessa:

Guarda i primi 1000 argomenti aperti nella categoria feature - ordinati per like (solo primo post) - di tutti i tempi… fammi un rapporto esecutivo su:

- Le 20 migliori funzionalità che CDCK dovrebbe costruire

- Le 20 funzionalità più facili che CDCK potrebbe costruire

- Duplicati ovvi

- Cose molto scarsamente definite

non farmi altre domande, esegui semplicemente la ricerca

- Esempio Gemini 2.0 Flash

- Esempio Gemini 2.5 Flash (con pensiero)

- Esempio GPT-4.1

- Esempio Claude 4 Sonnet

- Esempio Gemini 2.5 Pro

Esempio ibrido: Driver è Gemini 2.5 Pro e LLM del ricercatore è Gemini 2.0 Flash

Esempio ibrido

Debug della ricerca

In Discourse, puoi abilitare il debug avanzato dell’AI aggiungendo gruppi all’impostazione del sito ai_bot_debugging_allowed_groups. Con questo in atto, sei in grado di vedere i payload effettivi inviati all’LLM.

Limitazioni

Attualmente, non esiste un’opzione per inviare immagini all’LLM di ricerca. Questo sarà considerato nelle versioni future.

FAQ

-

Il Forum Researcher è disponibile su tutti i piani Discourse?

Il Forum Researcher fa parte del plugin Discourse AI, disponibile per siti self-hosted e sul nostro piano di hosting Enterprise. -

Il Forum Researcher può accedere a contenuti da categorie sicure?

Sì, se l’opzione “Includi privati” è abilitata nella sua configurazione e l’utente che interagisce con l’agente ha i permessi necessari per accedere a quelle categorie. -

Come posso controllare il costo dell’uso del Forum Researcher?

- Limita l’accesso a gruppi specifici e fidati.

- Utilizza le impostazioni “Numero massimo di risultati” e “Massimo token per post” per limitare l’elaborazione.

- Scegli LLM convenienti.

- Presta molta attenzione alle stime dell’“esecuzione a secco” prima di eseguire la ricerca completa.

- Utilizza le quote AI.